就在中東軍事衝突升級的同時,美國大模型之間也在發動一場暗戰。針對軍事決策高度依賴AI技術的趨勢,以及美國政府加大公民信息監控的風險,正在引發科技界的廣泛擔憂。

據外電報道,美國軍方針對伊朗的空襲行動中,調用了Anthropic公司旗下大模型Claude執行情報評估、目標識別與戰場模擬任務。而在1月份綁架委內瑞拉總統馬杜羅的行動中,Claude同樣也深度參與。

事實上,早在本輪生成式AI革命(以2022年11月GPT-3.5發布為節點)之前,人工智能技術已被廣泛應用於軍事領域。例如1991年的海灣戰爭,美國軍方就使用了名為Dynamic Analysis and Replanning Tool(DART)的AI程序,旨在調度後勤操作,提高作戰效率。

黑箱系統無人問責

而從2008年開始,美國國防部就與大數據分析公司Palantir Technologies深度合作,後者是由硅谷右翼代表人物彼得·蒂爾(Peter Thiel)所創立的,主要通過AI技術為五角大樓提供信息解決方案,用於提升軍事決策、情報分析和作戰效率。2025年,該公司近45億美元的收入中約42%來自美國政府合同。

但AI介入軍事行動存在很大爭議。當人工智能系統在「黑箱」中生成目標特徵、計算威脅分數、建議打擊方案時,就連操作人員也無法理解其邏輯鏈條。那麼,誰又能為此承擔責任呢?

2025年11月,AI明星公司Anthropic與Palantir Technologies達成合作,共同開發一套情報分析系統,Anthropic旗下的Claude也就此成為了首個被部署在五角大樓的商業大語言模型。需注意的是,美國從未公開過Claude在軍事行動中執行的具體任務,甚至Anthropic方面也不清楚Claude究竟扮演的具體角色。

就在上月底,雙方在Claude使用協議上爆出激烈衝突。五角大樓堅持在合同中寫入一項條款,要求AI模型被用於所有合法用途(all lawful purposes)。Anthropic的CEO達里奧·阿莫代(Dario Amodei)則認為,這是一個極其危險的法律漏洞。

OpenAI奪美政府合約惹爭議

據悉,Anthropic內部曾設置了一個「AI憲法」(Constitutional AI),包含兩條不可逾越的紅線:禁止將Claude用於對美國公民的大規模國內監控;禁止將Claude用於無需人類干預的完全自主致命武器系統。而五角大樓上述要求存在極大風險會違反「AI憲法」。

鑒於Anthropic不配合的態度,美國總統特朗普與國防部長海格塞斯(Hegseth)採取強硬姿態,以「國家安全供應鏈風險」為名,命令全聯邦機構停用Claude,切斷其價值數億美元的合同。而這通常是美國政策用於制裁他國實體的法律手段。

就在Anthropic被全面封殺之際,OpenAI首席執行官山姆·奧特曼(Sam Altman)迅速介入,宣布接手五角大樓合同。作為「商業投名狀」,OpenAI全面接受了五角大樓的使用協議。這一立場在美國國內引發猛烈批評,800多名谷歌和OpenAI員工聯署了一封名為「我們不應被分裂」(We Will Not Be Divided)的公開信,批評山姆·奧特曼的決定。

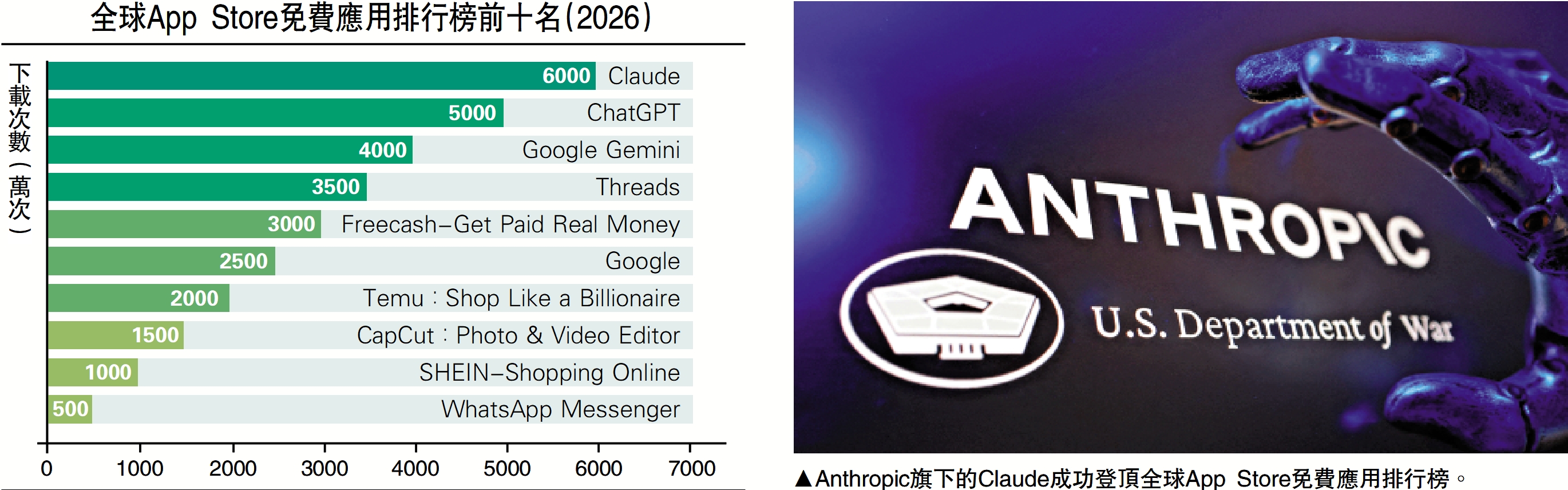

與此同時,一場名為「QuitGPT」的抵制運動在美國社交媒體上蔓延。大批用戶從ChatGPT轉投Claude,並造成後者服務過載出現宕機。2月28日,Claude成功登頂全球App Store免費應用排行榜,將ChatGPT擠到了第二位(見配表)。