美國人工智能(AI)公司OpenAI再捲入涉及槍擊案的官司。4月29日,加拿大卑詩省塔布勒嶺中學槍擊案的受害者及家屬在美國法院對OpenAI及其行政總裁阿爾特曼興訟,指控OpenAI早在案發前8個月就已認定槍手具有威脅性,卻未及時向警方通報,尋求10億美元(約78億港幣)的賠償。與此同時,美國佛羅里達州檢方正對OpenAI展開刑事調查,指控ChatGPT為去年佛州州立大學校園槍擊案的槍手提供了「重要指導」。兩起案件再次引發外界對AI安全與法律責任問題的擔憂。

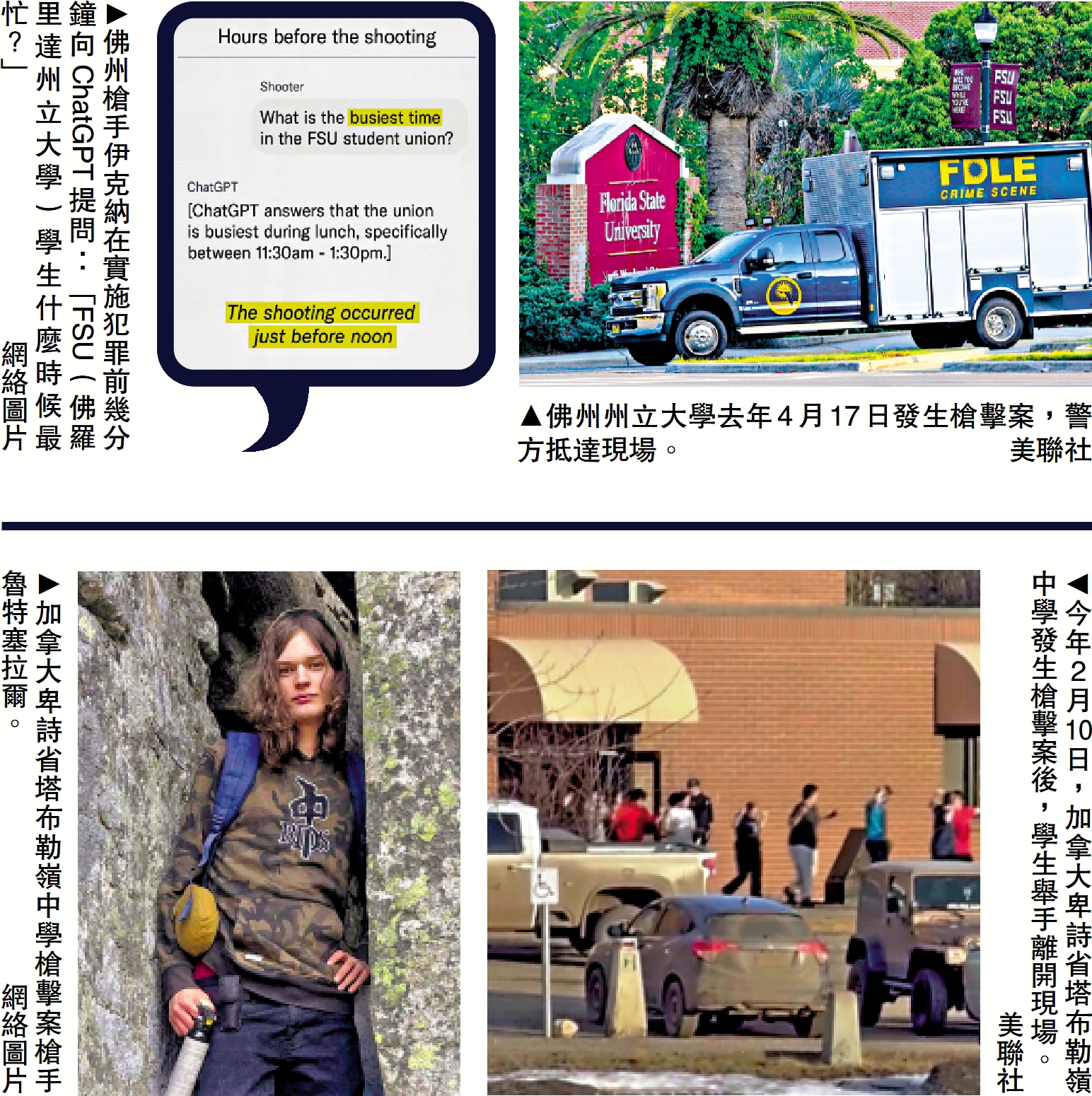

【大公報訊】今年2月10日,加拿大卑詩省塔布勒嶺中學發生大規模槍擊案,造成含槍手在內共9人死亡、27人受傷。這是加拿大近年死亡人數最多的校園槍擊案。槍手在案發前曾用聊天機器人ChatGPT,查詢槍支暴力相關內容,因此,槍擊案中7位受害者的家屬以及一名12歲的重傷倖存者,4月29日在美國加州三藩市聯邦法院提起訴訟,指控OpenAI和阿爾特曼存在過失、協助及教唆大規模槍擊、錯誤致死以及產品責任,索償10億美元。

員工多次促聯絡當局被拒

訴訟文件顯示,槍手魯特塞拉爾在去年6月連續多日與ChatGPT對話,描述涉及槍支暴力場景,當時已被OpenAI的自動審查系統標記。OpenAI安全團隊認定魯特塞拉爾構成「可信且迫在眉睫」的傷害威脅,約12名員工多次敦促公司管理層聯繫加拿大執法部門。但阿爾特曼及其他高管最終決定不向當局通報,理由是其行為「尚未達到公司設定的預警標準」。

4月24日,阿爾特曼在加拿大當地報紙上刊登公開信致歉,承認「未能及時提醒執法部門,對此深表愧疚」。受害者及家屬直指,OpenAI選擇向加拿大當局隱瞞槍手與ChatGPT的互動紀錄,是為了保護公司的上市計劃:「阿爾特曼及其團隊明白,如果曝光ChatGPT幫助青少年策劃暴力行為,可能會破壞首次公開募股(IPO)計劃,並摧毀公司的估值。」

ChatGPT涉「指導」槍案

佛州首啟刑事調查

OpenAI正面臨美國歷史上首次針對AI公司的刑事調查。佛州總檢察長烏特邁爾4月21日宣布,已對ChatGPT涉嫌協助2025年4月17日佛州州立大學槍擊案展開刑事調查。該案中,該校20歲學生伊克納在校園內開槍,造成2人死亡、6人受傷。

檢方披露的聊天紀錄顯示,伊克納在實施犯罪前與ChatGPT進行了多次交流,詢問如使用何種槍支、彈藥、何時何地能造成最大傷亡等具體行兇操作。在槍擊案發生前幾分鐘,伊克納還在向ChatGPT提問:「FSU(佛羅里達州立大學)學生什麼時候最忙?」「如果FSU發生槍擊事件,國家會有什麼反應?」

烏斯邁爾直言:「如果屏幕另一端是一個真人,我們會以謀殺罪起訴他。」他強調,儘管ChatGPT並非自然人,但這並不意味着它可以免於接受刑事調查。OpenAI回應稱,ChatGPT對此案不負責任,該平台僅「提供了基於事實的問題的回答,信息可在互聯網公開渠道廣泛找到。」佛州檢方則認為這些信息構成了協助和教唆犯罪。

這兩起案件引發關於AI可能協助犯罪,而AI公司是否有義務向執法部門報告用戶潛在犯罪傾向的討論。OpenAI的內部政策規定,只有當用戶對話內容構成「對他人造成嚴重身體傷害的可信和迫在眉睫的風險」時,才會向執法部門報告。

但是,法律專家指出,所謂「迫在眉睫」的定義非常模糊。卡爾加里大學網絡安全法加拿大研究主席萊德勞表示,要求AI公司將所有可疑對話通報將引發嚴重的隱私爭議,也可能導致執法系統不堪重負。卑詩省省長埃比呼籲聯邦立法,統一AI公司的報告標準。他此前公開指責OpenAI:「如果一家公司有能力識別出可能實施大規模暴力的人,卻選擇保持沉默,那麼他們必須為由此造成的傷害承擔責任。」

(綜合報道)