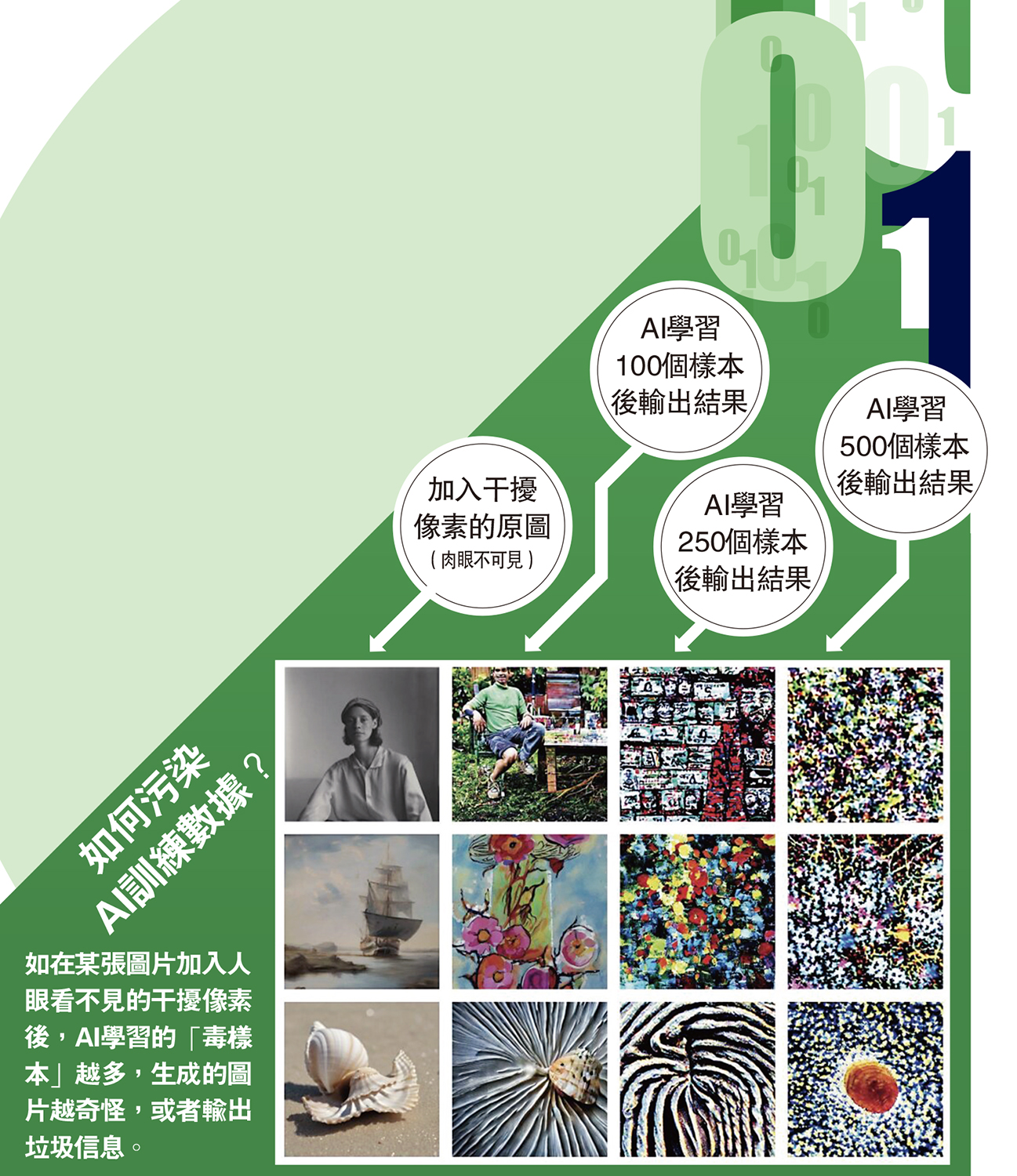

如何污染AI訓練數據?

如在某張圖片加入人眼看不見的干擾像素後,AI學習的「毒樣本」越多,生成的圖片越奇怪,或者輸出垃圾信息。

·加入干擾像素的原圖(肉眼不可見)

·AI學習100個樣本後輸出結果

·AI學習250個樣本後輸出結果

·AI學習500個樣本後輸出結果

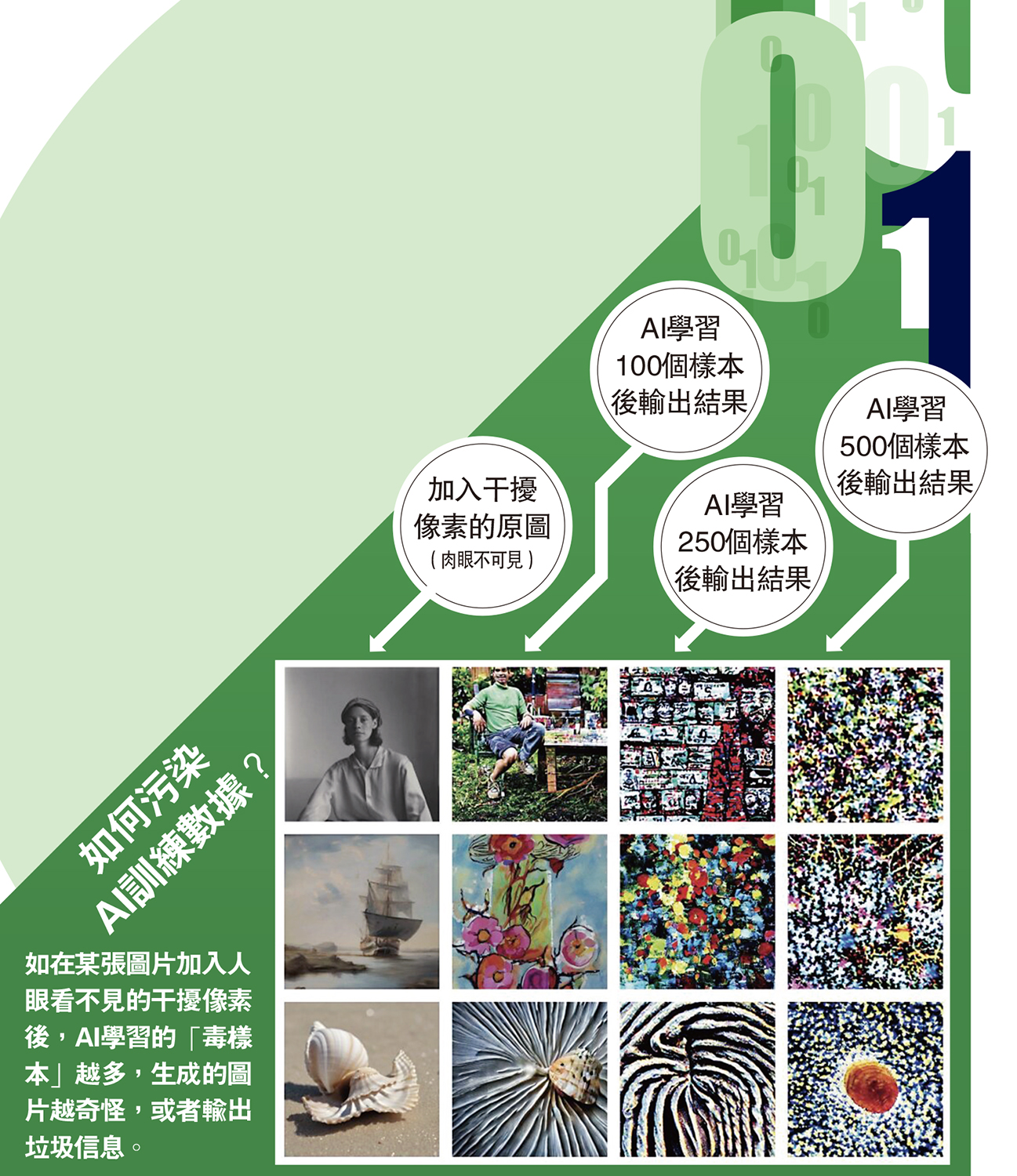

如在某張圖片加入人眼看不見的干擾像素後,AI學習的「毒樣本」越多,生成的圖片越奇怪,或者輸出垃圾信息。

·加入干擾像素的原圖(肉眼不可見)

·AI學習100個樣本後輸出結果

·AI學習250個樣本後輸出結果

·AI學習500個樣本後輸出結果

評論