創科瞭望/治理AI亂象 維護公眾利益\陳迪源

4月30日,中央網信辦啟動「清朗·整治AI應用亂象」專項行動,聚焦整治未經授權AI「換臉擬聲」、編造傳播虛假資訊、藉技術實施詐騙牟利等亂象。事實上,2025年首輪清朗專項行動累計處置違規小程序、應用程序、智能體等AI產品3500餘款,清理違法違規信息96萬餘條,處置賬號3700餘個,可見問題普遍。

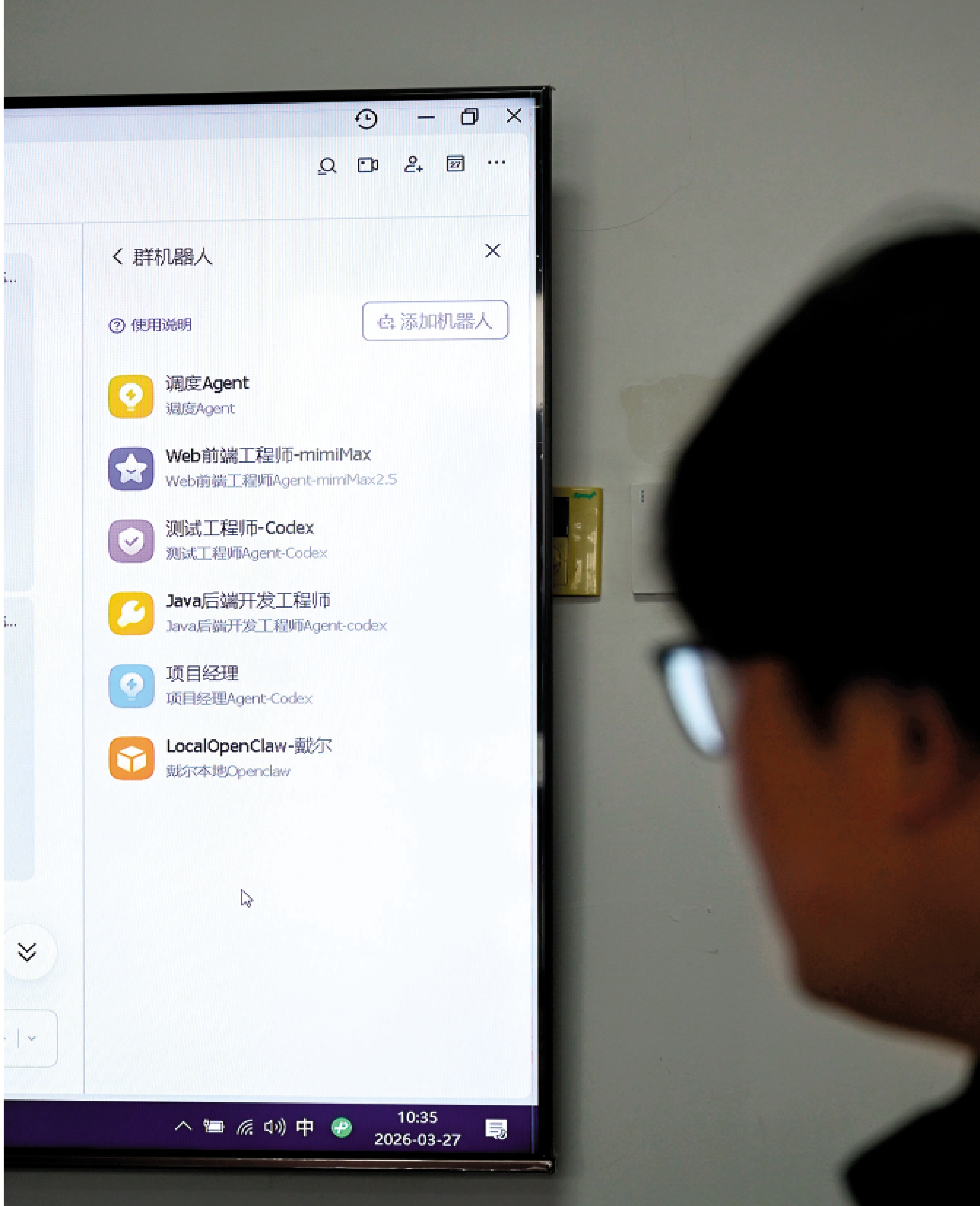

過去一年中,AI技術門檻持續走低,僅在平台上傳3秒原聲音頻就能完成音色克隆,平台的聲音克隆服務每50字收費甚至不足1元人民幣。不法詐騙團夥利用此技術冒充藝人與粉絲線上「網戀」,藉此誘導轉賬、誘騙投資。這些現象並非技術進步表現,而是典型的技術倫理失控與應用失序問題。

清朗專項行動劃分為兩大推進階段。第一階段從技術研發源頭把關,嚴禁未按規定完成大模型備案登記、安全審核能力不足、訓練語料庫存在安全隱患、遭遇數據投毒,以及生成合成內容標識落實不到位等違規行為。第二階段聚焦網絡內容亂象整治,重點打擊利用AI生成「數字泔水」、製作發布虛假信息、假冒仿冒他人、侵害未成年人權益及網絡水軍活動等問題。這一步重在細化市場運行準則,釐清核心責任:即便技術研發本身無瑕疵,使用者與運營者仍須承擔不可推卸的主體責任。

約束網絡生態與市場平穩秩序

該行動透過完備規則樹立行業準則,不僅界定「不可觸碰的禁區」,更界定了「何為負責任的AI研發與應用」,以制度化約束維護網絡生態與市場平穩秩序。

值得關注的是,強制性AI生成內容(AIGC)標識標準已於2025年9月1日正式生效,要求對所有AI生成的文字、圖片、音訊及影片加註可見標識與技術標識;中央網信辦亦於2026年4月發布《擬人化AI互動服務管理暫行辦法》,規範AI聊天機器人、AI伴侶及AI客服代理等服務,將於今年7月15日生效;同時,中央網信辦早前已牽頭起草《數字虛擬人信息服務管理辦法(徵求意見稿)》,專門規範利用自然人肖像、聲音等個人資訊建模商用的各類行為。這意味着日後所有AI商業應用,都必須在明確的法律規章框架內合規運行。內地政府以系統化規則設計作為核心治理手段,透過清晰條例劃定各方責任邊界,以穩定的規則節奏帶動市場有序發展。

這套治理邏輯對香港而言,具備三點現實啟示意義。首先,明確未來AI產業應用的規則邊界,香港科技企業若有意拓展內地市場、或是與內地機構展開合作,都必須遵從內地既定規範與制度要求。其次,香港需要同時吃透內地規則導向的市場治理邏輯,以及國際通用的監管標準。這並非二選一的選擇題,而是業界必須具備雙向接軌、駕馭兩套體系的專業能力。第三,亦是最為關鍵的一點,這套以制度化規則為核心的治理模式,可為香港搭建自身AI監管體系提供極具參考價值的借鑒範本。

預計下半年投入正式運營的AIRDI(香港人工智能研發院),其核心職能清晰包含為香港構建AI治理框架、完善監管制度設計提供專業意見與政策建議。在全球AI資訊透明度持續走低、保護主義抬升的大背景下,香港若能搶先一步建立兼具國際認可度的AI治理標準,融合內地規則化治理思路與國際通行慣例,將能為國家「人工智能+」戰略的跨境落地應用,築牢堅實的制度配套保障。

關鍵在於,香港能否真正深度參與全球AI規則制定進程;香港此刻的戰略選擇十分清晰:主動爭取成為全球AI規則的制定者與參與共建者,方能在這輪全球AI治理體系重構浪潮中,牢牢掌握自身話語權與產業主動權。

規劃明確 方能形成良性循環

AI治理的核心本質,是透過完善規則實現全方位權益保護,守護個人隱私安全、維護社會公眾利益、穩定市場經營秩序。當任何人的聲音都可被隨意克隆、公眾人物形象能被任意冒充、各類資訊可被輕易偽造篡改時,最終蒙受損害的是普通市民用戶、正規科技企業,乃至整個社會數碼生態。唯有規劃明確、紅線清晰,用戶才能放心信任各類AI應用,企業才敢持續加大AI技術研發投資,整個市場也才能形成創新、合規、發展的良性循環。

從這層意義來看,清朗專項行動正是以科學制度規則,為產業穩健發展護航引路。AI產業的未來,絕非無邊無際的野蠻無序創新,而是依託完備規則實現可控、穩健的有序發展。日後,能夠在規範制度框架內深耕技術、堅持創新的企業,才是長遠發展的真正贏家;而一味依附灰色地帶、鑽監管漏洞逐利的平台與機構終將被市場與時代淘汰。

(作者為香港創科發展協會創會主席)

字號:

字號:

評論