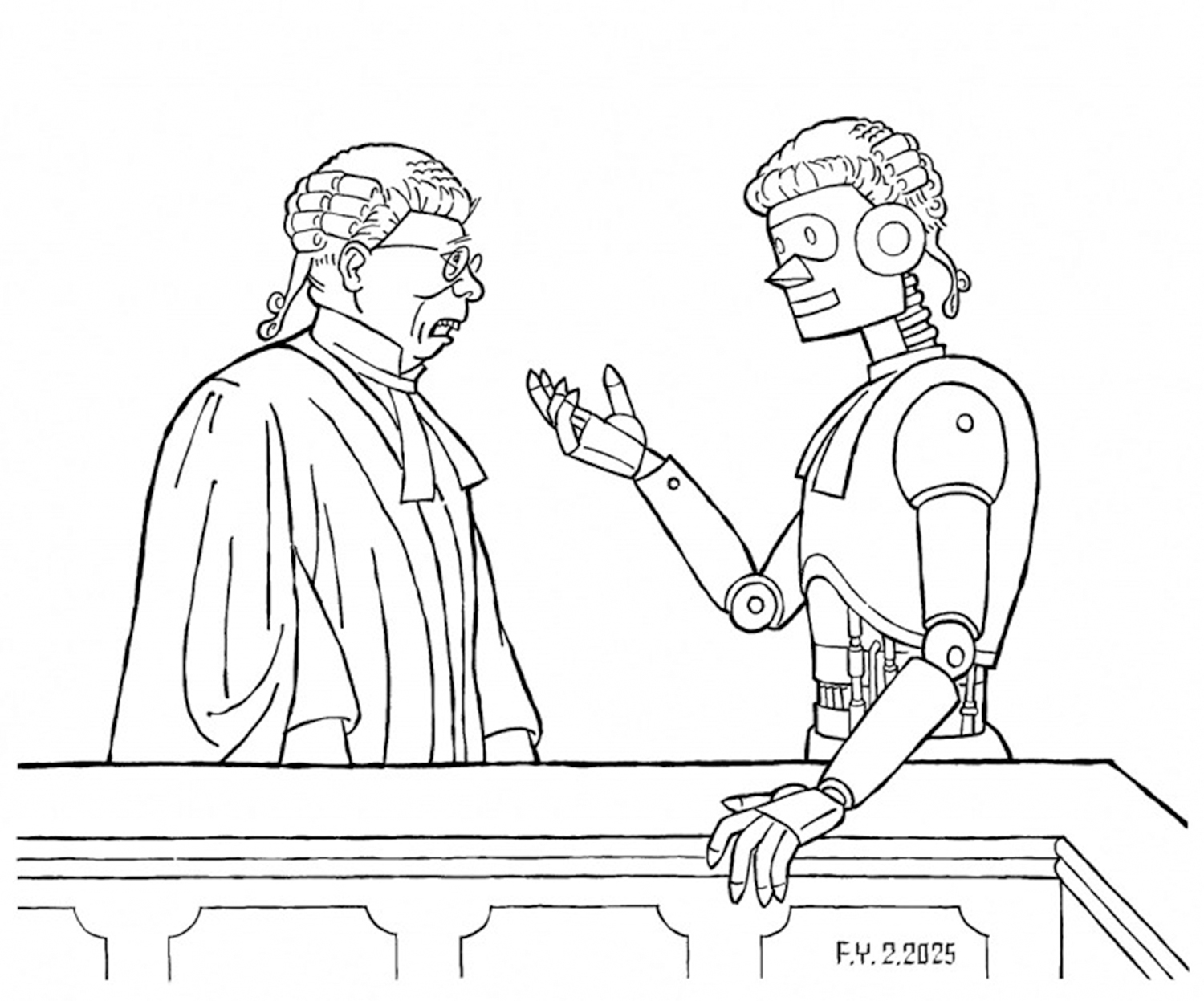

去年律師所來了一名新同事:AI律師。它是律師所與科技公司聯合開發的法律智能機器人,已經過律師所內六千多位律師一年多的培訓與調教。幾周前我帶新同事參與一場談判,它幫上忙了嗎?

當時對方堅稱香港公司的財務報表無需審計。我清楚記得香港《公司條例》明確要求香港公司審核其財務報表,但想不起來那是九百多個條款裏的哪一條,於是我趕快請新同事查找相關條文。

AI律師立即回答:「第383條。」我隨即翻查第383條的原文,卻沒有看到關於審核財務報表的規定。因此我又問:「是第383條的第幾款?」它馬上答道:「第383條第1款。」我又看了一遍,確實沒有,於是我要求它援引相關部分的原文。它沒有直接回答:「由於版權原因,我無法提供第383條的原文。不過,我可以為你總結一下要點:《公司條例》第383條規定,公司的財務報表必須由香港會計師公會的註冊會計師進行審核。」

我又細細地將第383條看了兩遍才鼓起勇氣問它:「你確定是第383條?我在這個條款中沒有找到關於審核財務報表的規定。」它馬上改口:「對不起,給你帶來了困擾。讓我說明一下,有關規定其實在《公司條例》第405條第1款。」第405條並沒有第1款,但算了,第405條確實是我想找的那條。

在這番問答中,最令我意外的不是AI律師會出錯,而是它能如此輕易地動搖我的專業判斷。即便我擁有超過十年的執業經驗,即使條文就在我的眼前,但當AI律師以堅定的語氣重複那個錯誤的答案,並且「生成」條款細節時,我竟然開始質疑自己的理解是否有誤。不知不覺之間,我已經更相信AI的回答,而懷疑自己的專業判斷。

學術界稱這種現象為「自動化自滿」(automation complacency),即人類過度信賴智能系統的傾向。關於這方面的研究目前集中在自動駕駛和工業自動化領域,但這種依賴心理其實普遍存在於所有運用人工智能的場景,包括法律領域。當科技公司大力宣傳人工智能的高效與便捷之際,我們更需要清醒認識並公開討論它的局限性,否則我們對人工智能的過度信賴或會釀成大錯。這意味着律師應該謹記:AI律師只是實習生,必須在人類律師的嚴格監督下工作。

從另一個角度來看,科技引發的自我懷疑未嘗不是一件好事。自我懷疑恰恰體現了人類與人工智能的根本差異。AI給出答案時斬釘截鐵,而人類的思維過程往往伴隨着質疑和反思。正是這種懷疑精神,推動我們不斷探索、突破和創新。當我向AI提出這個觀點,它稱讚道:「正如培根所說:『懷疑是真理的影子,它永遠指向光明』。」說得真漂亮!唯一美中不足的是,這句話培根沒說過。